阅读时间大约10分钟以上(7356字)

阅读时间大约10分钟以上(7356字)

2026-05-07 GENE-26.5:把机器人操作能力推向人类水平

作者:Marilyn Liu 出品:具身纪元

TL;DR:Genesis AI 团队发布旗下首个机器人基础模型系统 GENE-26.5。同一个模型、同一组权重、同一套硬件,1 倍真实速度,在烹饪、实验室移液、双手解魔方、做果昔、翻吸管、单手多物体抓取、线束装配、弹钢琴等长程接触密集任务上做端到端自主执行;大多数任务每个 skill 只需要不到 1 小时机器人数据(< 200 条 episode)。

背景:他们的判断是——操作(manipulation)才是机器人最有价值、也最难解的核心问题,且它不只是模型问题,是整套技术栈问题。GENE 同时重做了:1:1 仿人 20 主动自由度的 Genesis Hand 1.0、以人手为中心的非侵入式手套+第一/第三人称视频组成的数据引擎、跨语言/视觉/本体感觉/触觉/动作的机器人原生基础模型、用 GenesisWorld 仿真做闭环评测的体系,以及自研低延迟控制中间件(端到端最低 3ms 延迟,圆轨迹跟踪误差降一个量级)。

作者:Genesis Team,发布于 2026 年 5 月 7 日。原文:genesis.ai/blog/gene-26-5-advancing-robotic-manipulation-to-human-level

作者:Genesis 团队2026 年 5 月 7 日

引言

今天我们正式发布 GENE-26.5,这是我们的首个机器人基础模型系统,也是 GENE 家族对外公开的第一个版本。

GENE-26.5 的目标,是把通用机器人操作(manipulation)推向人类水平的能力。我们在一组长程、接触密集的任务上做了系统验证,包括烹饪、实验室自动化、解魔方、做果昔、线束装配、多物体抓取和弹钢琴。在这些任务中,系统始终使用同一个模型、同一套硬件平台、同一种数据策略和同一套控制栈,展示出广覆盖的灵巧技能。

这些任务并不是被设计成各自独立的 demo。它们是用来回答一个更大的问题:机器人能否以足够的精度、时序、协调性和自适应性,与物理世界进行真正"干活级"的交互?

在 Genesis,我们相信通用机器人通往实用化的路径,是从操作能力开始的。

Lab automation | 完全自主,1 倍速

TL;DR

操作(manipulation)是机器人最重要、却仍未被解决的问题

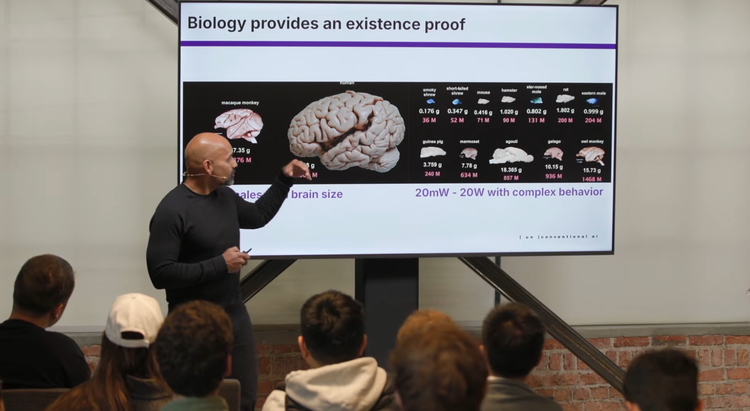

人类水平的灵巧度与能力,比表面看上去更近

解决操作问题需要的是完整堆栈式的系统思考,而不是单纯的"以模型为中心"

以人为中心的数据,搭配以人为中心的硬件方案,是预训练阶段的可扩展路径

高保真仿真,是模型迭代速度的终极加速器

操作问题:为什么,以及怎么做

这个问题本身

操作之所以是机器人领域最有价值的问题,是因为它把"智能"转化成了"有用的工作"。绝大多数体力劳动并不是在世界中穿行,而是在改变这个世界。

它同时也是迄今最难、最未解的问题。导航把世界建模为"障碍物 + 自由空间",并主动避免接触。运动控制和全身控制把接触当作支撑:地面是稳定的,模式是重复的,错误大多是可恢复的。操作完全不一样——接触本身就是任务。机器人必须理解世界、预测和推理交互的结果,并在物体形状、重量、摩擦、动力学都不确定的情况下,用精确的力和精确的时机去操作未知物体。错误会沿着长程任务一路放大,几毫米的偏差就足以决定成败。

在 Genesis,我们把操作视为机器人领域的那个核心问题。 一旦机器人能可靠且智能地控制它与世界之间的物理交互,其它一切都会自然成为它的支撑。

这是一个系统问题,而不只是 AI 问题

我们很早就意识到一个事实:机器人操作很难被当作一个纯模型训练问题来解决。机器人本身比纯数字 AI 复杂得多,它要求传感器、执行器、控制、数据和模型这几层之间紧密协同。任何一层的局限都会沿着系统传导,最终成为整体能力的天花板。所以,要造出能干活、又稳定可靠的机器人,光靠优化某个组件不够,必须在整套堆栈上同时做到位。

更有意思的是,当系统从底层开始被联合设计的时候,许多在"以模型为中心"视角下看似很难的挑战,反而可以在其它层更彻底地被解决掉。

数据就是最典型的例子。高质量演示数据的稀缺,至今仍是机器人研究的主要瓶颈之一。人类的交互数据是迄今最丰富、也最具可扩展性的真实世界监督来源——它天然涵盖了机器人最终需要泛化到的工作流和环境的多样性。

但现有方法都受困于一个根本性权衡:规模 vs. 保真度。野外采集的第一人称视频规模很大,但充满噪声、遮挡、可观测性也有限。遥操作和手持夹爪这类接口能给出更丰富的信号,却需要专门的操作员、受控的采集环境和"为采集而组织的工作流",而不是真实任务本身。结果就是:机器人数据集的"瓶颈"不只是规模,还有真实交互的多样性。

这一切的根源,是人和机器人之间的"具身鸿沟"(embodiment gap)。人手在自然干活时就能产生海量交互数据,但这些动作并不能直接迁移到现有机器人硬件上。

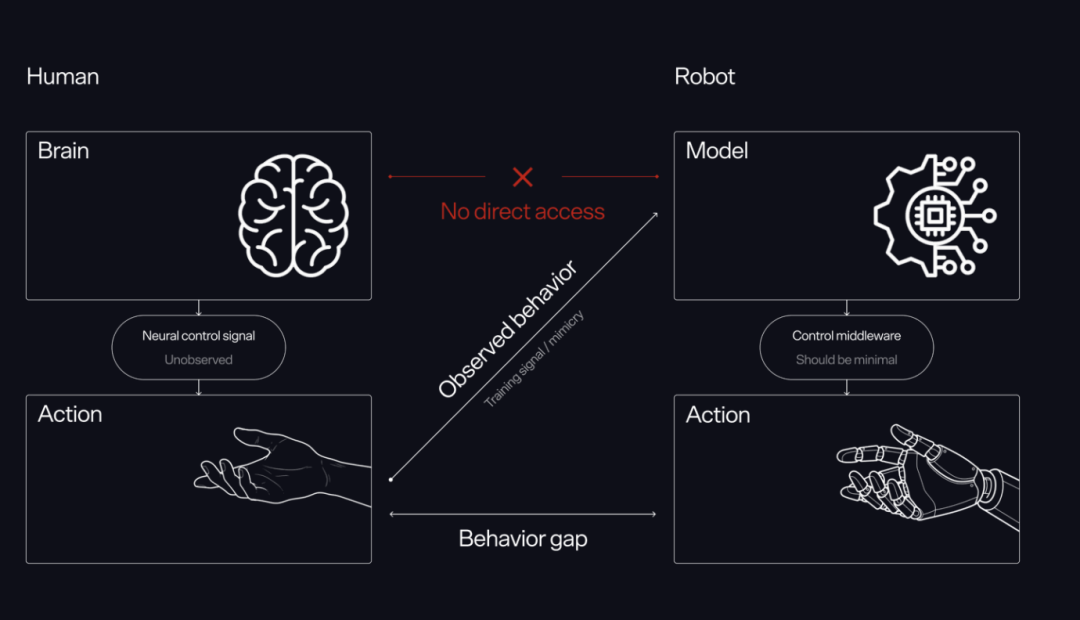

人和机器人之间没有直接通路,只能通过观测到的行为间接对齐——这就是行为鸿沟

现状

正因为如此,机器人研究者常常被迫在更深一层的系统约束下接受打折的方案。硬件限制收窄了可行交互的范围,进而塑造了数据采集策略——尽管整个真实世界本身就是为人手的工具体系打造的。控制中间件带来的延迟与各种非理想性——延迟、控制器动力学、传输误差、传动间隙、执行器误差——会让命令动作和真实系统状态之间产生偏差,从而使得模型训练倾向于使用遥操作信号作为监督,而这又隐式编码进了大量"机器人特有"的伪信号。评测瓶颈则继续拖慢进度:一台机器人、一个人类评估员、一次试一组;每次几分钟,每个 checkpoint 要花掉操作员几天。

但我们真的必须妥协吗?

不必。

与其在这些约束里继续做局部优化,我们退一步、把整个系统当作一个整体重新设计。如果目标真的是人类水平的操作,那么每一层都要为它服务:

填平具身鸿沟

在硬件层面就把鸿沟最小化,而不是在建模和算法里去补偿它。这意味着——不仅要用一只高自由度的手,还要让它在尺寸、运动学结构、自由度和软接触动力学上都尽可能贴近人手。

在真实工作流里采集高保真数据

数据采集接口必须保留人类自然的行为,同时提升可观测性和精度,让"在干活的过程中收集高质量演示数据"成为可能。

优化控制

把延迟和跟踪误差压到最低,使模型可以从"机器人遥操作"以外更广义的监督信号里学习。

构建机器人原生的模型

模型必须能够在语言、视觉、本体感觉、触觉和动作上做扩展,而且要满足复杂操作所需的频率和维度。

把评测也扩展起来

评测必须在多样性、效率、可复现性和吞吐量上,匹配上"基础模型规模"的迭代节奏。你只能改进你能测量的东西。

GENE 不只是一个模型,而是一个由这些原则定义的整体系统。GENE-26.5 是这个方向上的第一个发布。

把操作能力推向接近人类水平

人类水平的操作,远不止"把东西从 A 点搬到 B 点"那么简单。它是一门在空间和时间中编排接触的艺术。一个真正智能的机器人,应该能够即时合成多种与世界交互的方式:用一根手指去推、两根手指去捏、三根手指去稳、四根手指去重定向、整个手掌做强力抓取、用工具去延伸自身、并在两只手之间做无缝交接。

为了系统地讨论这个能力前沿,我们把机器人操作沿五个核心维度来评估:

空间精度(Spatial Precision)

:交互在哪里发生,接触点、物体、工具在位置上要被多准确地放置。

时间组合(Temporal Composition)

:动作什么时候、以多快的速度执行,才能在时间上产生想要的动力学效果。

接触丰富度(Contact Richness)

:同时存在的接触有多少、多样性有多大——从单点触碰到整手抓握、再到多物体交互。

接触协同性(Contact Coordination)

:多个接触必须同步到什么程度,才能合成一个连贯的动作。

工具中介交互(Tool-Mediated Interaction)

:通过中间物品延伸机器人自身物理边界的能力——既包括按设计用法使用工具,也包括以新颖但物理上合理的方式使用工具。

接触丰富度衡量的是接触的数量与多样性,而接触协同性衡量的是这些接触必须被多严格地同步起来。这套框架决定了我们怎么设计任务、怎么评估任务。我们不是在为孤立 demo 做优化,而是去挑选那些在真实场景里、能压满这些维度不同组合的任务。

GENE-26.5 能做什么

我们在覆盖家庭、实验室和工业三类工作流的真实任务上评测了 GENE-26.5。所有任务均以1 倍真实速度、单一模型 / 共享权重执行。(弹钢琴除外——那是为了测试我们的控制系统能力,顺便玩一下)。

下表把每个任务映射到这些维度的不同组合:

GENE-26.5 任务集合在五个维度上的难度分布

烹饪 / Cooking

一段长达四分钟、未经简化的真实场景任务,含 20 多个子任务。机器人完成了单手打蛋——展示精细的力控制和指间协同;双手协同操作——一只手重定向番茄,另一只手做精确切割;以及直接和间接工具使用——涉及毛巾、研磨盐瓶、打蛋器、刀、铲和煎锅等。一个有代表性的瞬间:在转移切好的番茄丁时,机器人把刀靠在砧板上做支撑,再通过双手协同完成转移。

Cooking | 完全自主,1 倍速

实验室移液 / Lab Pipetting

一个高精度的实验室工作流,包含移液、液体转移、试管封盖和离心机加样。机器人以正确姿态抓起移液枪,插入吸头、从烧杯中吸取液体并转移到试管、弹出吸头、封盖试管,然后通过轻按一个小小的"open"按钮打开离心机,再把试管放进转子。整套流程需要毫米级精度、工具使用、精细动作协同(比如拧上一个 1cm 大小的盖子),以及手内重抓握(in-hand re-grasping)——把移液枪重新调整姿态挂回支架上。

Lab pipetting | 完全自主,1 倍速

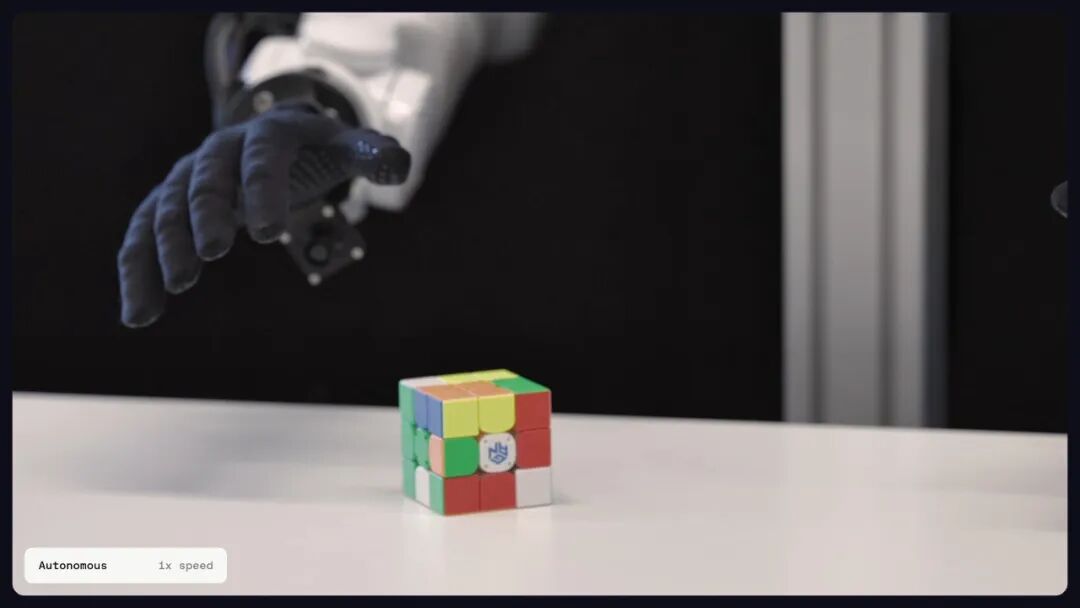

解魔方 / Solving a Rubik's Cube

魔方还原一直是机器人操作领域一个具有挑战性的基准。这项任务需要在魔方自身几何与运动学约束下做精细控制:每一次旋转都必须精准,同时物体要在多步操作之间保持稳定。在双手设置下挑战进一步加大,需要双臂、双手以及多根手指之间紧密协同。

在不依赖专门设计机械夹具的前提下,此前关于机器人解魔方的工作非常有限,OpenAI 2019 年的单手机械系统是一个关键里程碑。沿着这条路径,我们使用一个外部解算器在线生成闭环动作命令,把它翻译成语言指令,再交给模型执行。

据我们所知,这是首次有通用双手机器人系统能够还原魔方。

Solving a Rubik's Cube | 完全自主,1 倍速

做果昔 / Making a Smoothie

一个长程、由语言指令驱动的任务:从原材料开始制作一杯果昔。它要求小心处理多种材料状态——刚体、可变形物体和液体。

Making a smoothie | 完全自主,1 倍速

果昔吸管翻转 / Smoothie Straw Flip

上一个任务的延续,专门压上"操作吸管和它的塑料封套"——这是极易碎且半透明的物体。任务以一次"手内翻转"动作结尾,把吸管在一只手里就重定向到正确朝向,需要单手多指之间复杂且同步的协同。

Smoothie straw flip | 完全自主,1 倍速

多物体抓取 / Multi-Object Grasping

这个任务用来展示当 pick-and-place 由一只高度灵巧的手执行时会变成什么样,以及它相对于夹爪系统的效率提升。机器人用一只手、以四种不同的抓取方式同时抓起四个不同尺寸的物体,再分别放进对应的料盒。

Picking up multiple objects | 完全自主,1 倍速

线束装配 / Wire Harnessing

汽车工业里的圣杯任务之一:精确处理柔软、高度可变形的电缆和胶带。机器人协同双手把电缆捆扎成束、挂上支架、再用胶带缠绕固定。

Wire harnessing | 完全自主,1 倍速

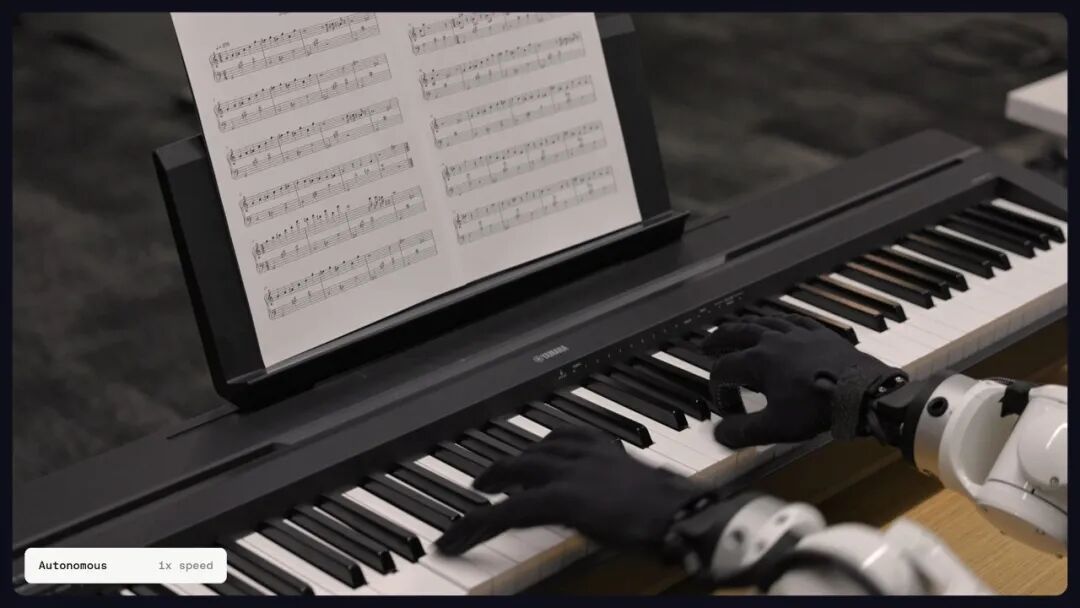

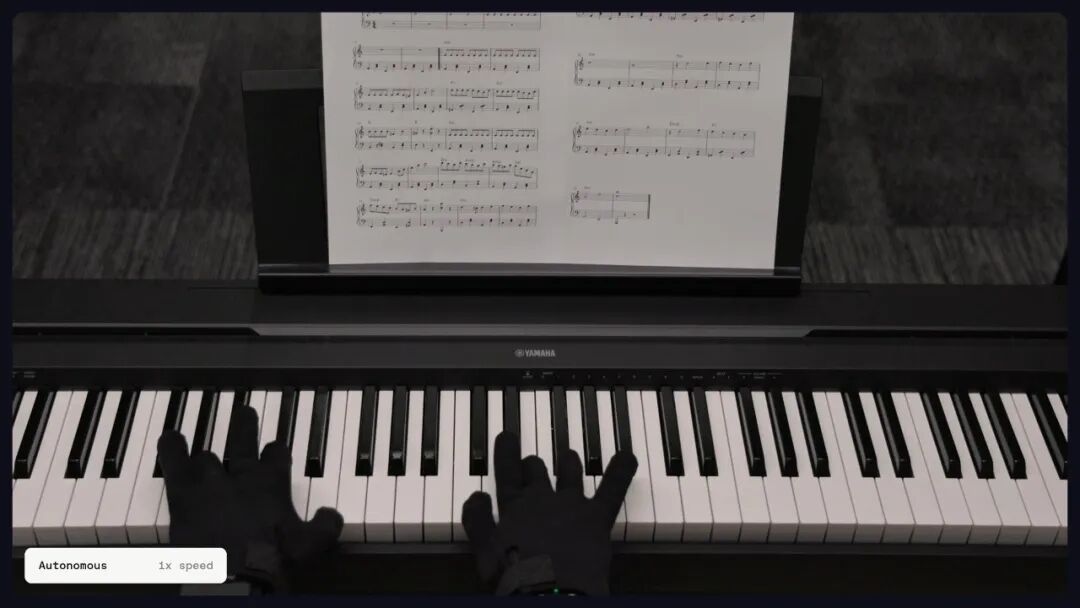

控制栈压力测试:弹钢琴 / Control Stack Stress Test: Piano Playing

这个策略虽然属于 GENE 模型家族,但它是单独通过仿真中的强化学习训练出来的,并以人类示范作为引导。这个任务专门用来验证我们控制栈的高速度和高精度跟踪能力。我们用了两段曲子来测试——Ferris Wheel和Rush-E。

Playing piano (Ferris Wheel) | 完全自主,1 倍速

Playing piano (Rush E clip) | 完全自主,1 倍速

对我们 demo 任务集合中绝大多数高难度技能而言,GENE 单个 skill 只需要少于 1 小时的特定任务机器人数据——对持续时长 20 秒以内的技能而言,这相当于不到 200 条 episode。

操作能力的扩展路径

全世界 80% 以上的体力劳动是操作任务。这些任务里几乎没有一个被记录下来过。

以人为中心的数据,是真实世界中扩展操作智能最重要、也最具可扩展性的源头之一。挑战不仅仅在于数据量本身,还在于——如何在采集数据的同时,保留人类交互的丰富性,并最大化它对机器人系统的可提取性与可用性。GENE 的整体设计,是围绕一条通往人类水平能力的扩展路径展开的:在多样化的人类示范上做预训练,用少量机器人数据做对齐,再通过来自真实世界和仿真的反馈持续改进。

Genesis Hand 1.0

要做灵巧操作的模型,得有一个能够表达丰富接触的物理接口。Genesis Hand 1.0 就是按这个原则设计的。这是一只高灵巧度、直驱式机械手,工程目标是与人手实现真正 1:1 的尺寸匹配。它具备20 个主动、可反向驱动的自由度,整个手掌和手指外覆软质材料,模仿人类皮肤的软接触物理特性。这种仿生设计让我们可以直接把人手动作映射到机械手上,几乎不需要复杂的 retargeting 算法,从而做到从人类示范到机器人之间近乎无损的信息传递。

Genesis Hand 1.0 | 左:与人手对比;右:动作中

GENE-26.5 当前所运行的硬件平台已经具备很高的灵巧度,但相对人手仍有进一步收窄具身鸿沟的空间。Genesis Hand 1.0 代表了我们硬件路线图上的下一步,它将作为 GENE 系统持续迭代的重要平台。

硬件不是模型的下游产物;它决定了"正确的数据"能不能被规模化。

以人为中心的数据引擎

世上最有价值的物理专长,活在人手的隐性知识里:装配工的直觉、实验员的精度、厨房线上的手速。要把这些知识规模化获取,就必须解决一个根本约束:数据采集本身必须不打断它所记录的工作。一旦采集行为改变了人的行为,规模和保真度都会被同时压低。

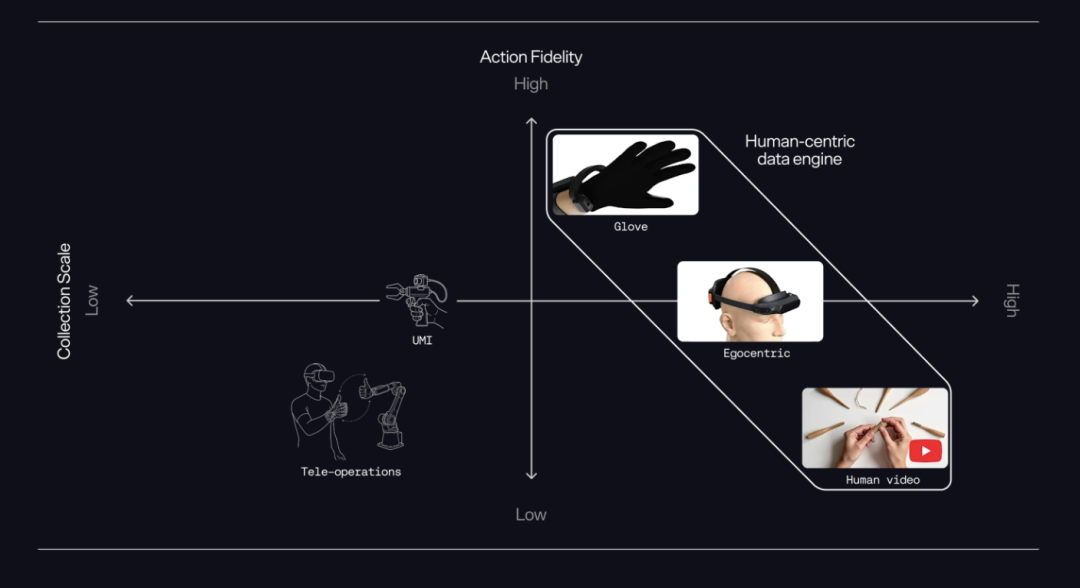

我们的数据引擎结合了三类互补来源,它们一起覆盖了"质量–数量"的帕累托前沿:

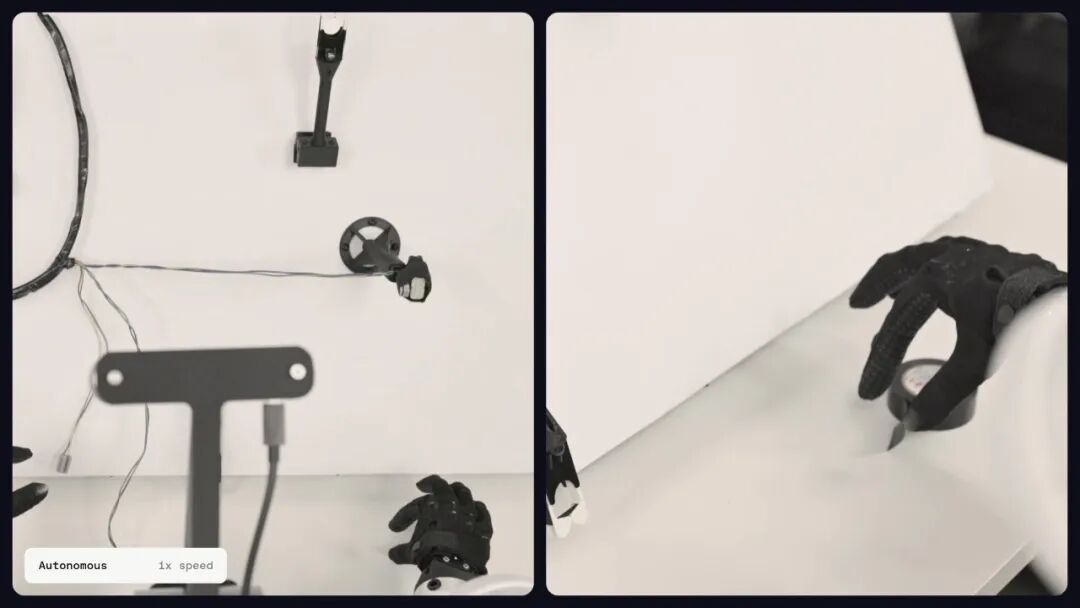

手套数据

——捕捉高保真的手部动作和触觉信号

第一人称视频

——记录自然行为和真实任务的多样性

第三人称视频

——提供互联网级别的物理交互覆盖

为了捕捉高保真交互,我们的数据采集手套使用基于 EMF 的手指追踪,并在整只手上密布触觉传感器。这套接口可以在人和机器人之间无缝共享,从而保证从数据到部署之间的一致性。手套被设计成最低侵入式(minimally-invasive),可以嵌入到现有工作流中,让真实工作以最低摩擦地变成数据采集本身。

以人为中心的数据引擎:在采集规模 vs 动作保真度的帕累托前沿上,由手套数据 + 第一人称视频 + 第三人称视频共同覆盖

以人为中心的数据引擎:在采集规模 vs 动作保真度的帕累托前沿上,由手套数据 + 第一人称视频 + 第三人称视频共同覆盖

一个机器人原生的基础模型

我们的目标是:学一个最能吸收规模的统一模型,把异构的输入和输出都囊括进来——语言、视觉、本体感觉、触觉、动作。我们用 flow matching 在轨迹上建模一个联合分布,既捕捉本质上是多模态的未来,也保留耦合的时间动力学。我们对它有三个目标:

能在异构、部分可观测的数据上做可扩展训练

可以训练在第一人称数据流(视觉、手部状态、语言)、手套数据(视觉、语言、精细化的手部状态、触觉)、机器人数据(控制信号)、互联网语言和视频数据上,无需显式对齐。

一个模型胜任所有任务

控制、生成式仿真、状态估计、逆动力学、目标推断、渲染、价值估计——这些都成为这个联合分布上的"条件查询",缺失的模态通过 denoising 来推断。

灵活地接入预训练模型作为"借力扩展"的方式

视觉-语言模型(VLM)编码意图和语义表征,世界模型(在我们的定义里,是动作条件下的视频生成模型)捕捉时间和物理动力学。这一联合分布可以同时利用这两类先验。

通往"即装即用"部署的扩展路径

我们与合作伙伴一起,已经在这些模态上累计采集了超过 20 万小时的数据。我们扩展的目标是即装即用(instant deployment):一台机器人进入新环境就能立刻开始干活,所需的数据采集和人工微调降到最低。要在实际中实现这一点,必须重新思考我们怎么构建模型、怎么评估模型。

我们把"即装即用"理解为高效且有效的任务级微调的极限——当确实需要适配时,所需的数据、时间和人力都尽量小。在极限情况下,当任务级所需投入趋近于零时,部署就接近于一种零样本泛化下的瞬时部署。

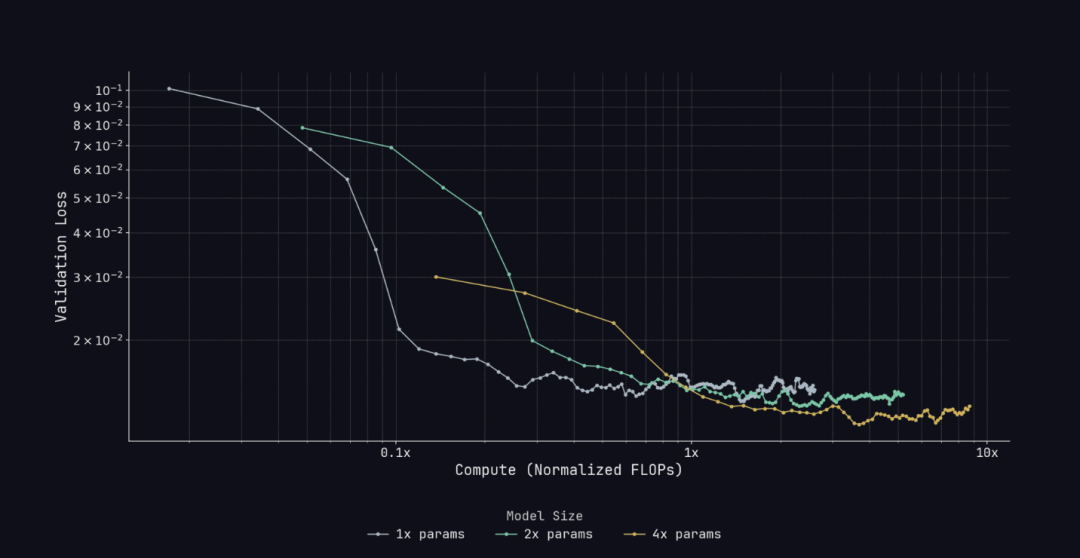

对于预训练,我们先用开环评测来研究 scaling 行为。如下图所示,扩大模型规模和算力会持续降低验证 loss,更大的模型最终收敛到更低的渐近误差。这与基础模型训练中已被广泛建立的 scaling laws 一致:更大的模型容量更大,并能从更多算力和数据中持续受益。

开环评测下,验证 loss 随算力下降;更大的模型有更低的渐近误差

但开环指标对机器人来说远远不够,闭环表现才是更有意义的能力指标——也就是动作会反过来影响未来观测的那种评估。

因此我们大量依赖仿真做闭环评测。在 Genesis,我们已经在仿真真实度上推了一年多。和真实世界中的模型评测相比,基于仿真的模型开发可控性、可扩展性、可复现性都强得多。先前在仿真里跑机器人基础模型评测的工作,往往需要在真实数据和仿真数据上做联合训练。得益于最新版 Genesis World 前所未有的真实度,我们可以在完全没有任何仿真训练数据的情况下,对模型做可扩展、可复现、系统化的评测。

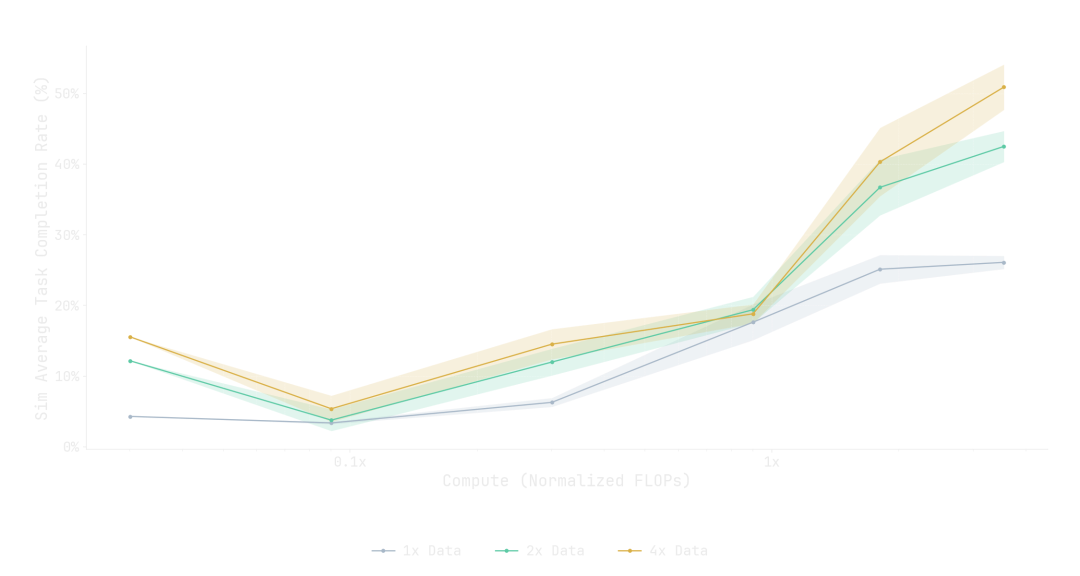

我们构建了非常庞大的仿真评测集合,覆盖大量任务和常见技能,涵盖光照、背景、物体属性、场景配置、任务指令等多种变化维度。在下面这张图里,每一个数据点代表 200 个评测设定、超过 150 小时的机器人运行时间;整张图如果在真实世界里跑下来需要2700 个机器人-人时。仿真使我们可以在真实世界里完全不可行的规模上,对基础模型能力做出有信息量的评估。结论很明确:扩展预训练数据规模,会在这些大规模闭环评测下带来更强的零样本泛化能力。

仿真闭环评测:扩大预训练数据规模带来更强的零样本任务完成率

在我们即将到来的版本更新中,我们会带来 Genesis World 的一次重要更新,并展示我们如何在仿真评测和真实世界评测之间建立强相关性。

最后,对于任务级微调,我们把评测落到真实世界。我们专门挑选了一批完全未在预训练中出现过的新任务,并放在反映即装即用部署约束的超低数据场景下评测。这包括我们内部定义的一组任务(每个只用大约20–30 分钟数据),以及一些更复杂的任务,例如我们 demo 视频里展示的那些。这套设置让我们可以严格地度量模型适配的效率。除了在零样本泛化上看到的提升之外,扩大预训练数据规模也会显著改善微调表现:模型适配得更快、所需数据更少、最终性能更高。

总的来看,结论是清晰的:扩展数据和算力,会同时提升泛化能力和适配效率。

真机微调:预训练数据从 0× 扩到 4×,平均成功率从 16.6% 一路爬升到 65.6%

低延迟、高保真控制

一个由 AI 控制的机器人系统,本质上是分层的——从模型输出,到中间控制信号处理,到底层 PID 控制器,再到电机层的 FOC 执行,跨越多层。在这些层之间,系统会累积延迟、跟踪误差、控制器伪影和执行器非理想性,所有这些都会让"模型想做什么"和"机器人实际做了什么"之间的鸿沟越来越大。

在基于遥操作的系统里,延迟和跟踪误差通常已经被隐式编码进了训练信号——所以模型学到的就是部署时同样要面对的这套机器人特定动力学画像。但当训练数据来自非机器人来源(比如人类动作)时,这个假设就不成立了。训练数据并不反映物理系统的动力学特性,于是训练和执行之间就出现了 mismatch。虽然可以在训练时人为加入延迟或系统噪声,但要把真实世界的动力学准确建模出来非常难——它依赖状态,会随着机器人的姿态、速度、负载、接触条件、控制器增益、传动行为以及执行器动力学每时每刻地变化。

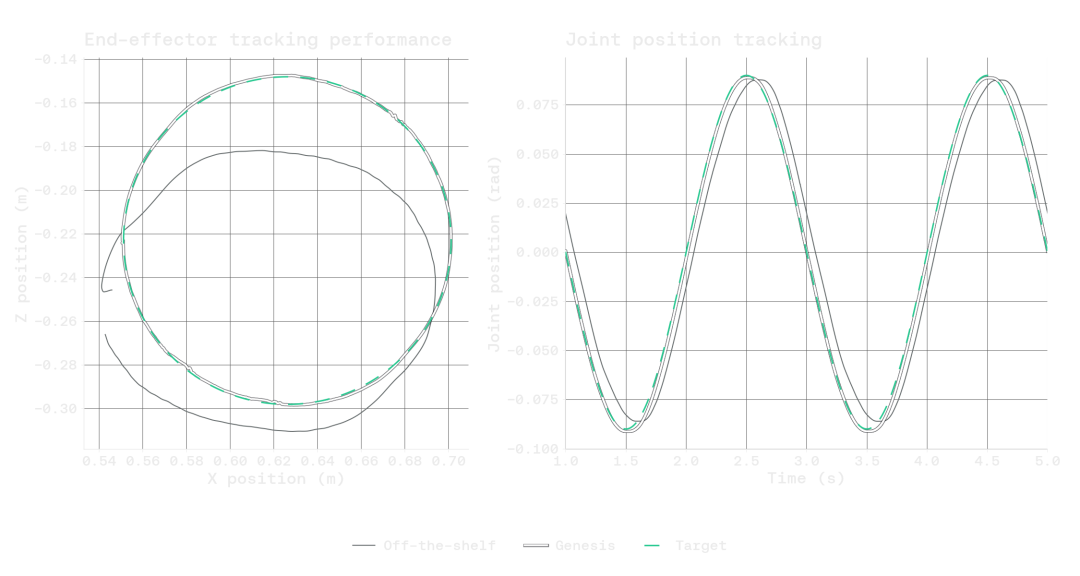

为了在源头上压低这种 mismatch,我们直接把双臂机械臂厂商自带的控制器整套替换为我们自研的控制中间件,重新设计了它的低延迟、高跟踪保真度和确定性执行。这套系统使用一个高性能的 impedance controller,在调优后端到端延迟可以做到低至3 ms。它通过一个 EtherCAT Y-slave 网络同时控制两条机械臂,使用 PREEMPT_RT 内核 + 隔离 CPU 核心来跑实时控制线程,使用 KickCAT 作为支持 Distributed Clocks 的 EtherCAT master,运行频率 500 Hz,同时支持位置控制和阻抗控制(含位置目标和速度目标)。

下面这组对比图展示了我们自研中间件 vs. 机械臂厂商自带控制器。在跟踪一个直径 15cm、4 秒一圈的圆形轨迹时,原厂控制器的平均跟踪误差约为20mm,我们这套压到了大约2mm——整整一个数量级的提升。在阻抗模式下的单关节正弦跟踪基准里,原厂控制器有大约80ms延迟,我们这套响应在9ms之内,调优后可进一步压到约3ms。

左:末端执行器跟踪一个 15cm 圆——原厂 ~20mm 误差,自研 ~2mm;右:阻抗模式下单关节正弦跟踪——自研控制器贴合度显著优于原厂

这就是我们眼里的"全栈机器人"具体是什么样:通信层(KickCAT、UDP、PREEMPT_RT 调度、核心隔离)、控制器层(阻抗控制、PID、梯形规划)、以及之上的接口全部由我们自己拥有。整套堆栈保持一致,意味着任何一层的改进都能直接传导到其它层。这一点对于真正闭合"人到机器人"的鸿沟至关重要:通过把延迟、跟踪误差和隐藏的控制器伪影都最小化,我们让 GENE 真正有可能去从人类动作里学习,而不是只能依赖机器人特定的遥操作信号。

结语

我们认为,GENE-26.5 是通往人类水平机器人操作的一个早期但重要的脚印。操作能力不会单靠模型训练自己长出来。它需要一个连贯的系统:能够表达丰富接触的硬件、能够保留人类交互的数据采集方式、能够把"意图"和"执行"之间的鸿沟压到最小的控制系统、能够在多模态监督上做规模化吸收的模型,以及能让迭代变得可扩展、可复现的评测基础设施。

这次发布反映了我们一直以来的判断:通向通用机器人的路径,是从操作开始的;而操作必须作为一个全栈问题来解决。GENE-26.5 只是一个开始,但它已经搭起了一个可扩展的基座——人类数据、能干活的硬件、高保真控制、真实仿真、丰富评测,以及来自真实世界的快速反馈。

更多内容即将到来。

原文:https://genesis.ai/blog/gene-26-5-advancing-robotic-manipulation-to-human-level